File robots.txt được xem là một trong những yếu tố đầu tiên bạn cần phải kiểm tra và tối ưu hóa, đóng vai trò quan trọng giúp cho trình thu thập dữ liệu của những công cụ tìm kiếm có thể biết được khả năng thu thập dữ liệu liệu đến các trang hoặc tệp trên website. Trong bài viết dưới đây EnMedia sẽ giải đáp File robots.txt là gì và toàn bộ các thông tin quan trọng liên quan đến file robots.txt.

File robots.txt là gì?

File robots.txt là một tập tin văn bản khá đơn giản có dạng .txt. Tệp này chính là một phần của Robots Exclusion Protocol (REP) có chứa một nhóm các tiêu chuẩn của web quy cách Robot web hoặc Robot các công cụ tìm kiếm, thu thập các dữ liệu trên trang web, idex, truy cập và cung cấp nội dung cho người dùng.

Robots Exclusion Protocol (REP) gồm có lệnh Meta Robots, Site-Wide Instructions và Page-Subdirectory,…Hỗ trợ hướng dẫn các công cụ Google xử lý những liên kết, ví dụ: Follow hoặc Nofollow link. Thực tế, việc tạo robots.txt trên WordPress sẽ giúp cho các nhà quản trị web có thể linh hoạt và chủ động hơn trong việc có nên cho phép các con bot của công cụ Index một số phần nào đó trong trang web của mình hay không.

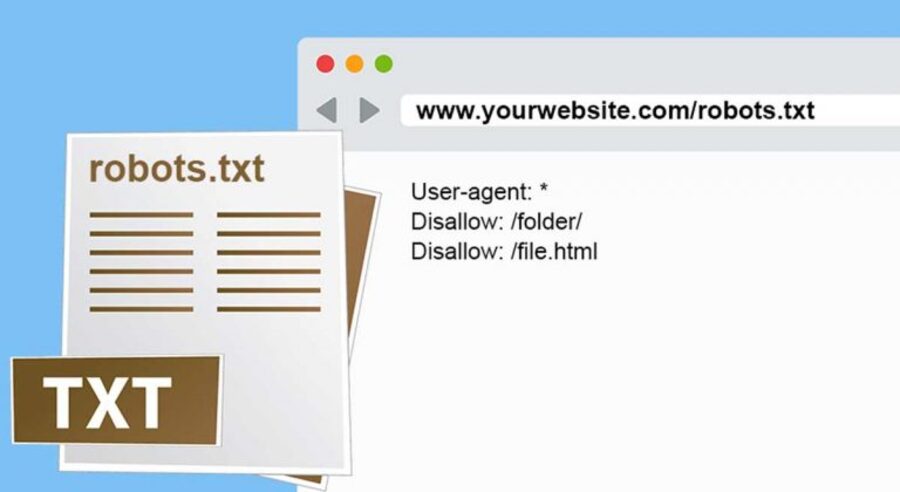

Vị trí của file robots.txt trên một website

Việc tạo ra website trên WordPress cũng sẽ tự tạo ra file robots.txt đặt ở bên dưới thư mục gốc của server. Ví dụ: Nếu như website của bạn đặt ở thư mục gốc tại địa chỉ enmedia.vn, lúc này bạn có thể truy cập vào file robots.txt tại đường dẫn enmedia.com/robots.txt, sẽ nhận được kết qủa ban đầu như sau:

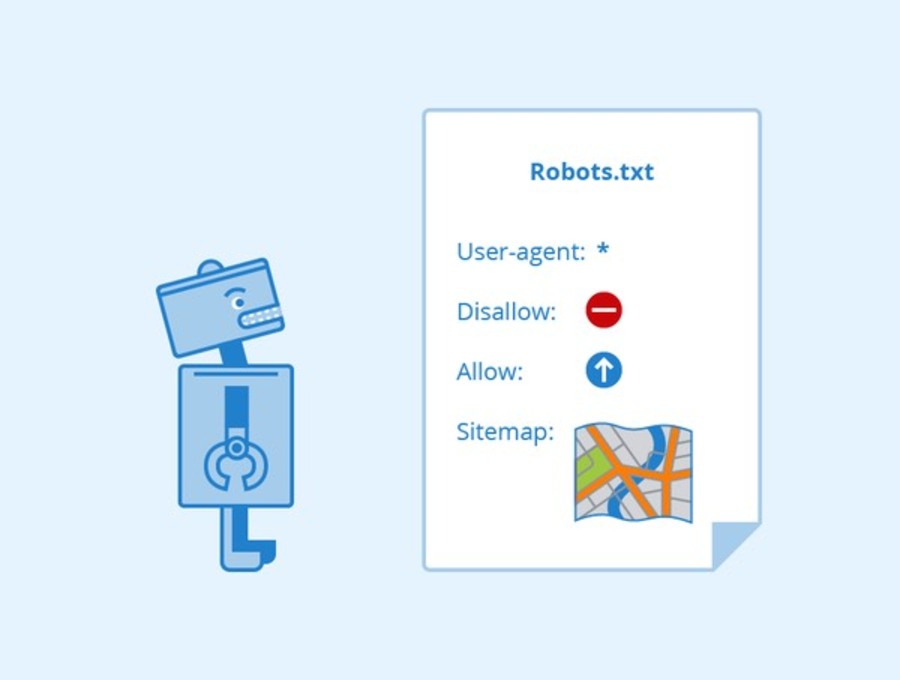

User-agent: *

Disallow: /folder/

Disallow: /file-html

Trong đó dấu * ở phần sau của User-agent có nghĩa là quy tắc sẽ được áp dụng đối với mọi loại bost ở mọi nơi trên website. Tại trường hợp này, file sẽ thông báo cho các bots biết chúng không được phép vào file của thư mục mục wp-folder và wp-includes, bởi hai thư mục này chứa khá nhiều các thông tin nhạy cảm.

Lưu ý: Đối với một file ảo được WordPress tự thiết lập mặc định khi cài đặt mà không chỉnh sửa được (kể cả khi nó đang hoạt động). Thông thường, vị trí file robots.txt WordPress chuẩn sẽ được đặt ở thư mục gốc, còn được gọi là public_html và www hoặc là tên của website. Để tạo file robots.txt riêng, bạn cần tạo một file mới thay thế file cũ đặt ở thư mục gốc đó.

Thẻ Meta Keyword là gì? Cách tối ưu Meta Keyword chuẩn SEO, chi tiết https://enmedia.vn/the-meta-keyword-la-gi/

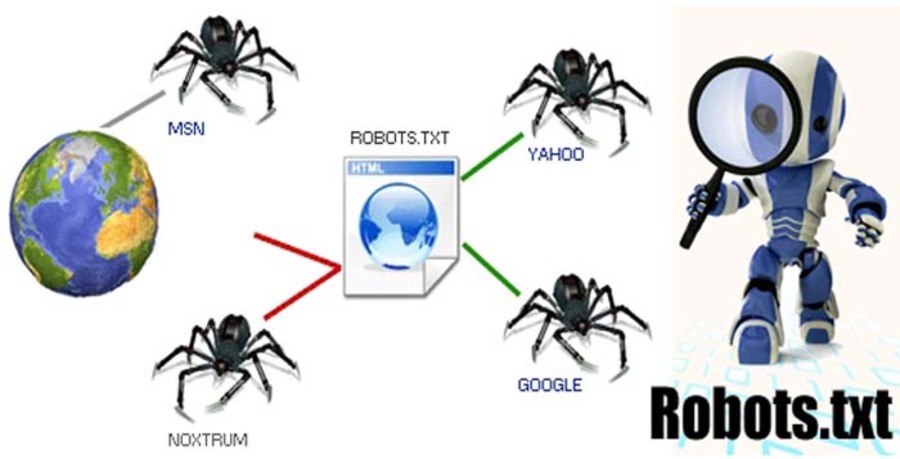

Cách thức hoạt động của file robot.txt

Các công cụ tìm kiếm có hai nhiệm vụ chính đó là:

- Crawl: Cào/phân tích các dữ liệu tại trang web nhằm khám phá nội dung.

- Index nội dung: Để đáp ứng yêu cầu cho những tìm kiếm đến từ người dùng.

Crawl được dữ liệu của trang web khi các công cụ phải được đi theo các liên kết giữa các trang, kết quả nó sẽ thu thập dữ liệu thông qua hàng tỷ website khác nhau. Quá trình crawl dữ liệu này còn có tên gọi khác nữa đó là “Spidering”.

Sau khi đã đến trang web, trước khi spidering các con bot của công cụ Google sẽ tìm đến các file robots.txt WordPress. Nếu như nó tìm thấy 1 tệp robots.txt, lúc này nó sẽ đọc được tệp đó trước khi tiến hành các bước kế tiếp. Tại file robot.txt có chứa thông tin về cách các công cụ của Google nên thu thập những dữ liệu của website. Lúc này các con bot sẽ được hướng dẫn thêm nhiều thông tin cụ thể khác cho quá trình này.

Lưu ý: Nếu như tệp robots.txt không chứa chỉ thị nào cho các User-agent hoặc trường hợp không tạo file robots.txt cho website, các con bots sẽ thực hiện thu thập những thông tin khác trên trang web.

Lợi ích của việc tạo file robots.txt

Khi tạo ra robots.txt cho website bạn có thể kiểm soát việc truy cập các con bots đến những khu vực nhất định trên trang web. Tuy nhiên nếu vô tình bạn nhập sai một vài thao tác sẽ vô cùng nguy hiểm làm cho Google không thể index trang web của bạn.

Tuy nhiên việc tạo ra file robots.txt vẫn đem lại nhiều hữu ích sau:

- Ngăn cho các nội dung không bị trùng lặp không xuất hiện trên website.

- Một số phần của trang được giữ ở chế độ riêng tư.

- Các trang kết quả tìm kiếm nội bộ được giữ không hiển trên SERP.

- Chỉ định vị trí Sitemap.

- Ngăn chặn các công cụ của Google index ở một số tệp nhất định tại trang web của bạn như: PDF, hình ảnh,..

- Cài đặt thời gian bằng lệnh Crawl-delay là cách ngăn máy chủ bị quá tải khi các trình thu thập dữ liệu tải lên nhiều nội dung cùng một lúc.

Nếu như không muốn ngăn các web crawler thu thập dữ liệu từ website thì bạn không cần phải tạo robots.txt.

Xem thêm: 50 Thuật ngữ SEO cơ bản và quan trọng nhất bạn cần biết, TẠI ĐÂY

Những hạn chế của file robots.txt

Ngoài những lợi ích trên file robots còn có những hạn chế sau bạn cần phải lưu ý trước khi tiến hành tạo hoặc chỉnh sửa tệp robots.txt. Sẽ tùy thuộc từng mục tiêu và tình huống, hãy cân nhắc những cơ chế khác nhau để đảm bảo URL không tìm thấy trên trang web.

Các công cụ tìm kiếm không hỗ trợ các lệnh trong file robost.txt

Với hướng dẫn trong các file robotst.txt sẽ không thể bắt một trình thu thập dữ liệu có thể làm theo một hành vi cụ thể nào đó. Với trình thu thập dữ liệu sẽ có quyền quyết định có nên tuân theo các lệnh tại tệp này hay không. Đối với các Googlebot và các chu trình thu thập dữ liệu trang web có uy tín khác sẽ tuân thủ theo hướng dẫn trong file robots.txt, nhưng vẫn có một số trình thu thập dữ liệu khác sẽ không tuân thủ.

Do đó, nếu như bạn muốn đảm bảo thông tin của mình được an toàn trước các trình thu thập dữ liệu trang web, hãy sử dụng các phương thức chặn khác như bảo vệ các tệp riêng tư bằng mật khẩu của máy chủ.

Các trình thu thập dữ liệu phân tích theo cú pháp khác nhau

Đối với các trình thu thập dữ liệu wb có sự uy tín sẽ chấp hành theo các lệnh trong file robot.txt, tuy nhiên mỗi trình thu thập dữ liệu có thể có cách thức riêng nhằm diễn giải các lệnh. Bạn cần nắm được các cú pháp thích hợp cho từng các trình thi thập dữ liệu web, bở do một số trình thu thập có thể sẽ không hiểu được một số hướng dẫn nhất định.

Một số file robots.txt bị chặn vẫn có thể lập chỉ mục

Google sẽ không thu thập dữ liệu hay lập chỉ mục nội dung đã bị file robots.txt chặn. Tuy nhiên vẫn có thể tìm thấy và lập ra chỉ mục của một URL đã bị tệp robots.txt chặn khi có những nơi khác liên kế tới URL đó. Cuối cùng sẽ cho ra kết quả là các địa chỉ của URL và có thể bao gồm thông tin công khai khác như văn bản liên kết trên các đường liên kết đến trang vẫn được xuất hiện tại kết quả tìm kiếm của Google.

Để ngăn URL của bạn xuất hiện tại kết quả tìm kiếm của Google, bạn hãy bảo vệ các tệp trong máy chủ bằng mật khẩu, sử dụng thẻ meta noindex, tiêu đề phản hồi hay xóa toàn bộ trang.

Hướng dẫn 3 cách tạo và chỉnh sửa file robots.txt trên WordPress

Dưới đây là cách tạo và chỉnh sửa file robot.txt trên WordPress qua 3 cách sử dụng Yoast SEO, Plugin All in One SEO và upload file robotst.txt qua FTP.

Tạo và chỉnh sửa file robost.txt bằng Yoast SEO

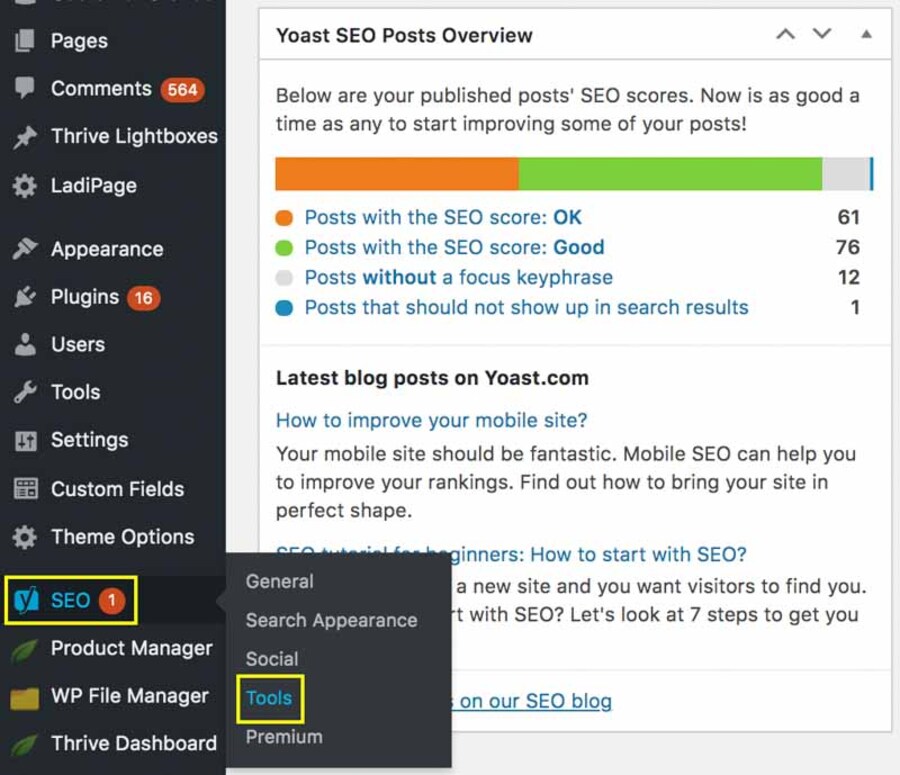

Chỉ với vài bước đơn giản bạn có thể tạo và chỉnh sửa trên chính WordPress Dashboard. Đầu tiên bạn đăng nhập vào website, lúc đăng nhập bạn sẽ thấy giao diện của trang Dashboard.

Ở phía bên trái của màn hình, bạn chọn SEO > Tools > File editor

Nếu WordPress chưa được kích hoạt trình quản lý chỉnh sửa file, lúc này tính năng file editor sẽ không xuất hiện. Do đó, hãy kích hoạt chúng thông qua FTP, lúc này mục robots.txt và htaccess file (nơi giúp tạo ra file robots.txt) xuất hiện.

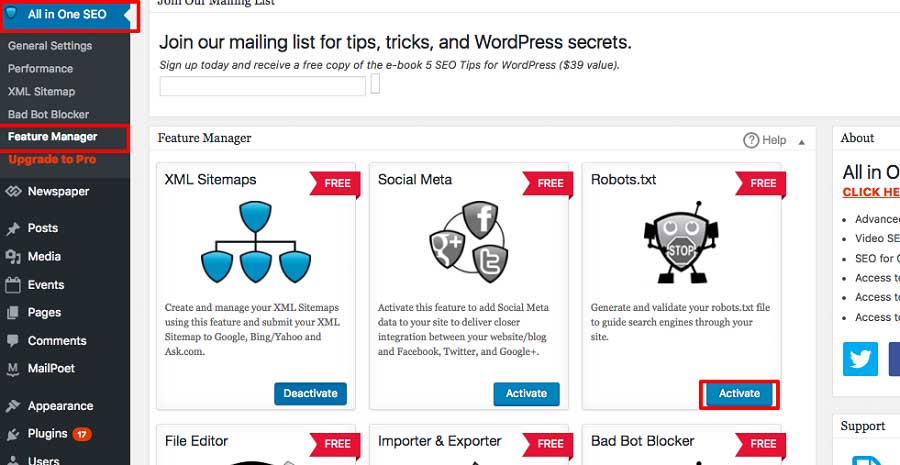

Cách tạo bằng bộ Plugin All in One SEO

Việc sử dụng bộ Plugin All in One SEO sẽ giúp bạn tạo file robots.txt trên WordPress một cách nhanh chóng. Đây còn được xem làm mộ plugin ích đối với WordPress bởi sự đơn giản và dễ sử dụng.

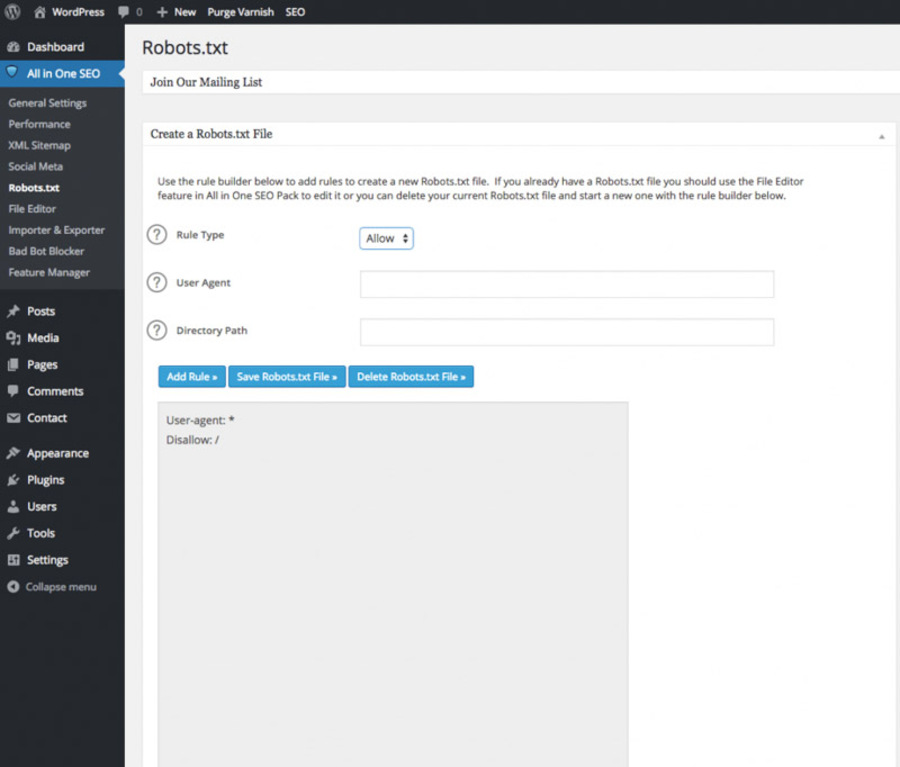

Để bắt đầu tạo file robot.txt, bạn đi đến giao diện chính của Plugin All in One SEO Pack rồi click vào All in One SEO > Features Manager > Activate ở mục robots.txt.

Trên giao diện của bạn lúc này sẽ xuất hiện nhiều tính năng. Khi đó, tại mục robot.txt sẽ xuất hiện như là một tab mới tại thư mục lớn All in One SEO, bạn có thể tạo lập và điều chỉnh file robots.txt tại đây.

Lưu ý: Bộ plugin này sẽ có một chút khác biệt với Yoast SEO, thư mục All in One SEO sẽ làm mờ đi thông tin của file robots.txt thay vì bạn được chỉnh file như ở công cụ Yoast SEO. Điều này làm cho bạn hơi bị động trong việc chỉnh sửa file robot.txt.

Tuy nhiên, với yếu tố này sẽ giúp cho bạn hạn chế được các thiệt hại cho website của mình. Đặc biệt những nguy cơ gây hại cho website ở một số Malware bost.

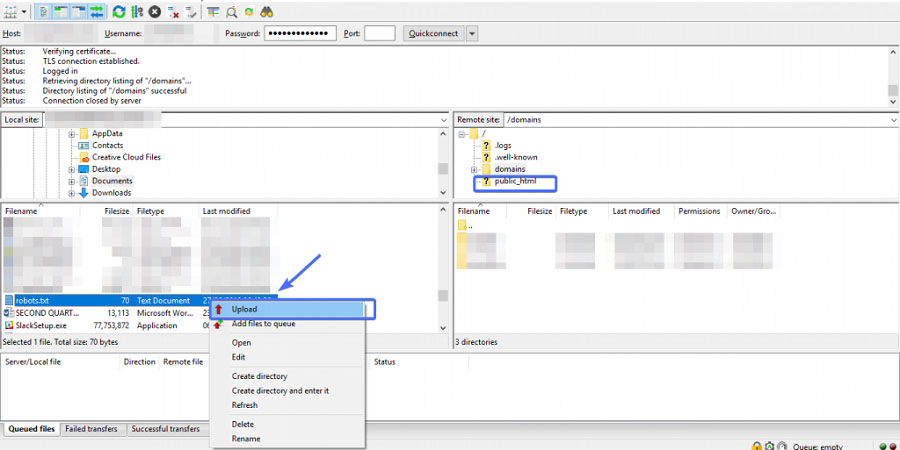

Cách tạo rồi upload file robots.txt qua FTP

Đây là cách tự tạo file robot.txt thủ công trên WordPress, với cách này bạn chỉ mất vài phút làm bằng tay.

Bạn có thể sử dụng Notepad hoặc Textedit để tạo file theo Rule, sau đó upload file qua FTP không cần phải sử dụng plugin, quá trình này sẽ diễn ra một cách nhanh chóng.

Cách kiểm tra và xác nhận hợp lệ cho file robots.txt

Bạn hoàn toàn có thể xem nội dung của robots.txt bằng cách điều hướng đến robots.txt URL, tuy nhiên cách tốt nhất để kiểm tra và xác nhận đó là thông qua tùy chọn robots.txt Tester của Google Search Console.

Đầu tiên bạn đăng nhập vào tài khoản Google Search Console, rồi nhấp vào robots.txt Tester tại tùy chọn Crawl, tiếp đến nhấn vào nút TEST. Nếu nút Test chuyển sang màu cam và nhãn thay đổi ALLOWED thì mọi thứ đều ổn. Nếu đường kẻ gây ra lỗi sẽ được đánh dấu, lúc này có nghĩa đã gặp sự cố.

Đừng bỏ lỡ: Dịch vụ SEO Đà Nẵng

Các quy tắc khi tạo file robots.txt

Dưới đây là một số nguyên tắc khi tạo file robots.txt bạn cần nắm rõ:

- Các file robots.txt phải được đặt ở các thư mục cấp cao nhất của trang thì các con bot mới tìm thấy được.

- Lưu ý chữ hoa và chữ thường khi đặt tên, tên chính xác là “file robots.txt”.

- Không được đặt /wp-content/plugins hoặc /wp-content/themes/ vào mục Disallow. Bởi nó sẽ làm cản trở các công cụ nhìn nhận được chính xác về giao diện blog hay website.

- Một số User-agent sẽ chọn cách bỏ qua các file robots.txt chuẩn của bạn, phổ biến với các User- agent bất chính như Malware robots và các trình Scraping.

- Thông thường các tệp robots.txt sẽ có sẵn và được công khai tại web nên bạn chỉ cần thêm /robots.txt ở cuối bất kì Root Domain nào, để xem các chỉ thị từ trang web đó. Có nghĩa là bất kì ai cũng đều thấy trang bạn muốn hoặc không muốn crawl. Do đó, đừng dùng các tệp này để ẩn các thông tin cá nhân của người dùng.

Những điều cần lưu ý khi sử dụng file robots.txt

Bạn cần phải đảm bảo không chặn bất kỳ nội dung hay phần nào trên trang web mà bạn đang muốn Google index. Đối với những liên kết trên trang bị chặn sẽ không được các bot theo dõi, trừ khi các link này được liên kết với những trang khác.

Link juice sẽ không được truyền từ những trang bị chặn đến trang đích. Do đó, nên như bạn muốn dòng sức mạnh link juice truyền đến các trang này, hãy sử dụng phương pháp khách thay vì tạo robot.txt WordPress.

Tránh sử dụng file robots.txt để ngăn các dữ liệu nhạy cảm xuất hiện trong kết quả SERP. Bởi các trang web có chứa thông tin các nhân có thể sẽ liên kết với nhiều trang khác. Vì vậy, các con bot sẽ bỏ qua những chỉ thị của tệp robots.txt trên Root Domain hoặc trang chủ của bạn, do đó trang web này vẫn có thê lập chỉ mục được.

Bạn có thể chặn trang web này ra khỏi các kết quả tìm kiếm bằng cách sử dụng một phương pháp khác thay vì tạo file robots.txt WordPress như dùng mật khẩu hay Noindex Meta Directive. Có một số công cụ tìm kiếm có nhiều User-agent, điển hình là Googlebot-Image cho tìm kiếm hình ảnh và Google dùng Googlebot cho những tìm kiếm miễn phí.

Hầu hết tất cả các User-agent từ một công cụ đều tuân theo một quy tắc. Do đó bạn không cần phải chỉ định các lệnh cho từng User-agent. Nhưng với việc làm này có thể giúp bạn có thể điều chỉnh được cách index nội dung của trang web.

Nội dung của file robots.txt WordPress sẽ được các công cụ tìm kiếm lưu trữ, tuy nhiên thông thường nó vẫn cập nhật nội dung bên trong bộ nhớ cache ít nhất 1 lần/1 ngày. Ngoài ra, nếu bạn thay đổi tệp và muốn cập nhật tệp nhanh hơn, hãy sử dụng chức năng Gửi ở trình kiểm tra tệp robots.txt.

Robots.txt đảm bảo tốt cho SEO

Cần phải kiểm tra thật kỹ robots.txt của bạn, đảm bảo rằng bạn không chặn bất cứ phần nào của web mà bạn muốn xuất hiện trên các công cụ tìm kiếm.

Không chặn thư mục CSS và JS, trong quá trình thu thập thông tin và lập chỉ mục Google có thể xem một trang web như người dùng thực, nếu như các trang của bạn cần CSS và JS hoạt động đúng cách sẽ không bị chặn.

Trường hợp trang web của bạn là WorPress, bạn không cần phải chặn quyền truy cập vào các thư mục wp-include và wp-admin. WordPress sẽ thực hiện công việc một cách tuyệt vời bằng thẻ meta robots hoặc bạn có thể làm bất cứ điều gì cũng không sao.

Không được cố gắng chỉ định những quy tắc khác nhau cho mỗi bot trên công cụ tìm kiếm, bởi nó có thể gây nhầm lẫn và khó đề vập. Khi sử dụng user-agent tốt nhất chính là: * và cung cấp bộ quy tắc cho toàn bộ chương trình.

Những câu hỏi thường gặp về file robots.txt

Dưới đây là một số câu hỏi thường gặp khi nhắc đến file robots.txt:

Kích thước tối đa của file robots.txt là bao nhiêu?

Kích thước đối đa khoảng 500 kilobyte.

Vị trí của file robot.txt WordPress trên website?

File robot.txt WordPress nằm ở domain.com/robots.txt.

Chỉnh sửa robots.txt bằng cách nào?

Bạn có thể sử dụng một trong các plugin WordPress SEO như All in One, Yoast hoặc bằng phương pháp thủ công, cho phép chỉnh sửa robots.txt từ WordPress backend.

Nếu Disallow vào nội dung Noindex trong robots.txt sẽ có điều gì xảy ra?

Nếu trường hợp này xảy ra Google sẽ không bao giờ thấy được lệnh Noindex vì nó không thể Crawl dữ liệu của trang web.

Cách để ngừng tất cả hoạt động thu thập dữ liệu trang web?

Bạn có thể tạm dừng tất cả hoạt động thu thập dữ liệu bằng cách trả về một mã kết quả của HTTP 503 cho toàn bộ URL, gồm cả tệp robots.txt, không nên thay đổi tệp robots.txt để chặt các hoạt động thu thập dữ liệu.

Nếu không có tệp robot.txt thì sẽ như thế nào?

Nếu như thiếu tệp robot.txt, trình thu thập thông tin trên công cụ tìm kiếm, giả sử tất cả các trang có sẵn tại trang web đều ở chế độ công khai và nó có thể sẽ được thu thập dữ liệu, tiếp đến thêm vào chỉ mục của nó.

Điều gì xảy ra khi robots.txt không được định dạng tốt?

Điều này sẽ phụ thuộc vào vấn đề: Nếu như các công cụ tìm kiếm không hiểu được nội dung của tệp tin vì bị dính cấu hình sai, nhưng họ vẫn truy cập vào trang web, bỏ qua bất cứ điều gì trên robots.txt.

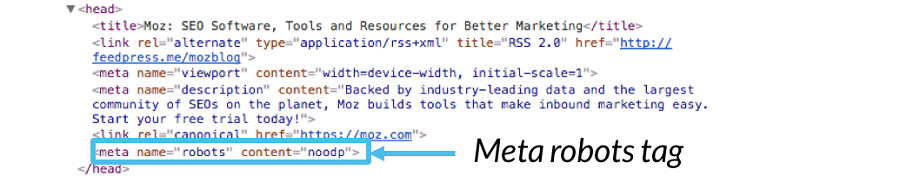

Robots.txt, Meta robot và X-robot khác nhau ở điểm nào?

Điểm khác nhau cơ bản đầu tiên đó là robots.txt là một tệp văn bản còn Meta robot và X-robot là các Meta Directives và chức năng ba loại này cũng hoàn toàn khác nhau.

Meta robot là những đoạn mã hướng dẫn cho chu trình thu thập thông tin liên quan đến cách thu thập dữ liệu hoặc lập các chỉ mục nội dung của trang web.

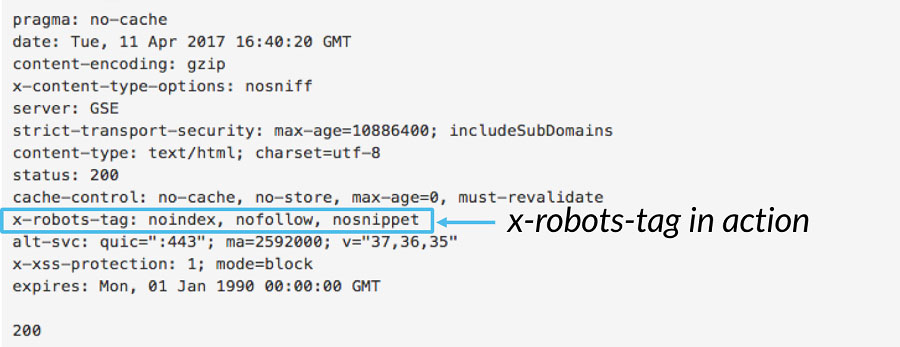

X-robot chính là một phần trong tiêu đề HTTP được gửi từ máy chủ trang web, khác với thẻ meta robots, thẻ này không được đặt ở HTML của một trang. X-robot được sử dụng nhằm ngăn chặn các công cụ tìm kiếm lập chỉ mục các tệp như hình ảnh, PDF,..và ngay cả đối với những tệp không phải HTML

Tất cả các lệnh dùng được trong thẻ meta robots đều có thể chỉ định là một X-robots. Nhờ cách cho phép việc kiểm soát cách các tệp cụ thể nào đó được lập chỉ mục, nên X-robots có thể cung cấp linh hoạt hơn thẻ meta robots và tệp robots.txt.

Khi tạo file robost.txt sẽ ra lệnh index toàn bộ thư mục và trang web, nhưng đối với meta robot và X-robots có thể ra lệnh index ở cấp độ trang riêng lẻ.

Kết luận

Qua bài viết chắc hẳn các bạn đã nắm rõ file robots.txt là gì và các kiến thức cần thiết liên quan đến nó. Bạn sẽ không phải tốn quá nhiều thời gian để tạo và kiểm robots.txt theo ý muốn của mình, điều này sẽ giúp hỗ trợ các con bot trên công cụ tìm kiếm thu thập được dữ liệu cũng như idex trang web của bạn một cách nhanh chóng. Hy vọng qua bài viết sẽ mang đến cho các bạn những thông tin hữu ích để áp dụng tốt vào công việc, nếu bạn muốn nâng cao kiến thức về SEO đừng quên theo dõi khóa học seo tại Đà Nẵng của chúng tôi nhé!

Cảm ơn bạn đọc đã theo dõi!